메타, 엔비디아와 ‘역대급’ AI 칩 공급 계약 체결: 루빈과 베라가 그리는 인공지능의 미래

2026년 현재, 전 세계 테크 산업의 시선은 다시 한번 실리콘밸리의 두 거인, 메타(Meta)와 엔비디아(NVIDIA)에 쏠리고 있습니다. 메타가 엔비디아로부터 수백만 개의 차세대 AI 칩을 공급받기로 하는 다년(multi-year) 규모의 초대형 계약을 체결했다는 소식이 전해졌기 때문입니다. 이번 계약은 단순한 하드웨어 구매를 넘어, 메타가 추구하는 범용 인공지능(AGI)과 고도화된 AI 에이전트 시대를 향한 기술적 배수진을 친 것으로 풀이됩니다.

메타의 이번 결정은 단순히 GPU 숫자를 늘리는 것에 그치지 않습니다. 엔비디아의 최신 로드맵인 블랙웰(Blackwell)을 넘어 루빈(Rubin) GPU, 그리고 그레이스(Grace)와 베라(Vera) CPU에 이르기까지, 인프라 전체를 엔비디아의 풀 스택 플랫폼으로 재편하겠다는 의지가 담겨 있습니다. 이번 포스팅에서는 “Semicolon;”이 분석한 메타와 엔비디아의 이번 협력이 2026년 이후 AI 생태계에 가져올 파급력을 상세히 짚어보겠습니다.

그레이스와 베라: 엔비디아 CPU의 독립적인 부상과 전력 효율의 혁신

이번 계약에서 가장 주목해야 할 점은 메타가 엔비디아의 그레이스(Grace) CPU를 단독(standalone) 칩 형태로 대규모 도입하는 최초의 빅테크 기업이 되었다는 사실입니다. 그동안 엔비디아의 CPU는 주로 GPU와 결합된 형태로 사용되어 왔으나, 메타는 이를 독립적인 프로세서로 활용하여 데이터 센터의 효율성을 극대화할 계획입니다. CNBC의 보도에 따르면, 이는 AI 모델의 학습(Training)뿐만 아니라 실행(Inference) 및 데이터베이스 처리 과정에서 전력 소비를 획기적으로 줄이기 위한 전략적 선택입니다.

엔비디아의 하이퍼스케일 컴퓨팅 부문 부사장 이안 벅(Ian Buck)은 로이터와의 인터뷰에서 “그레이스 CPU는 일반적인 데이터베이스 작업에서 기존 대비 절반의 전력만으로도 동일한 성능을 낼 수 있음을 증명했다”고 밝혔습니다. 나아가 2027년 도입 예정인 차세대 CPU 베라(Vera)는 이보다 더 높은 전력당 성능(Performance-per-watt) 향상을 약속하고 있습니다. 탄소 중립과 에너지 비용 절감이 데이터 센터 운영의 핵심 과제가 된 2026년 현재, 메타의 이러한 선택은 지속 가능한 AI 인프라 구축의 표준이 될 것으로 보입니다.

루빈(Rubin) GPU와 스펙트럼-X: 거대 AI 인프라의 완성

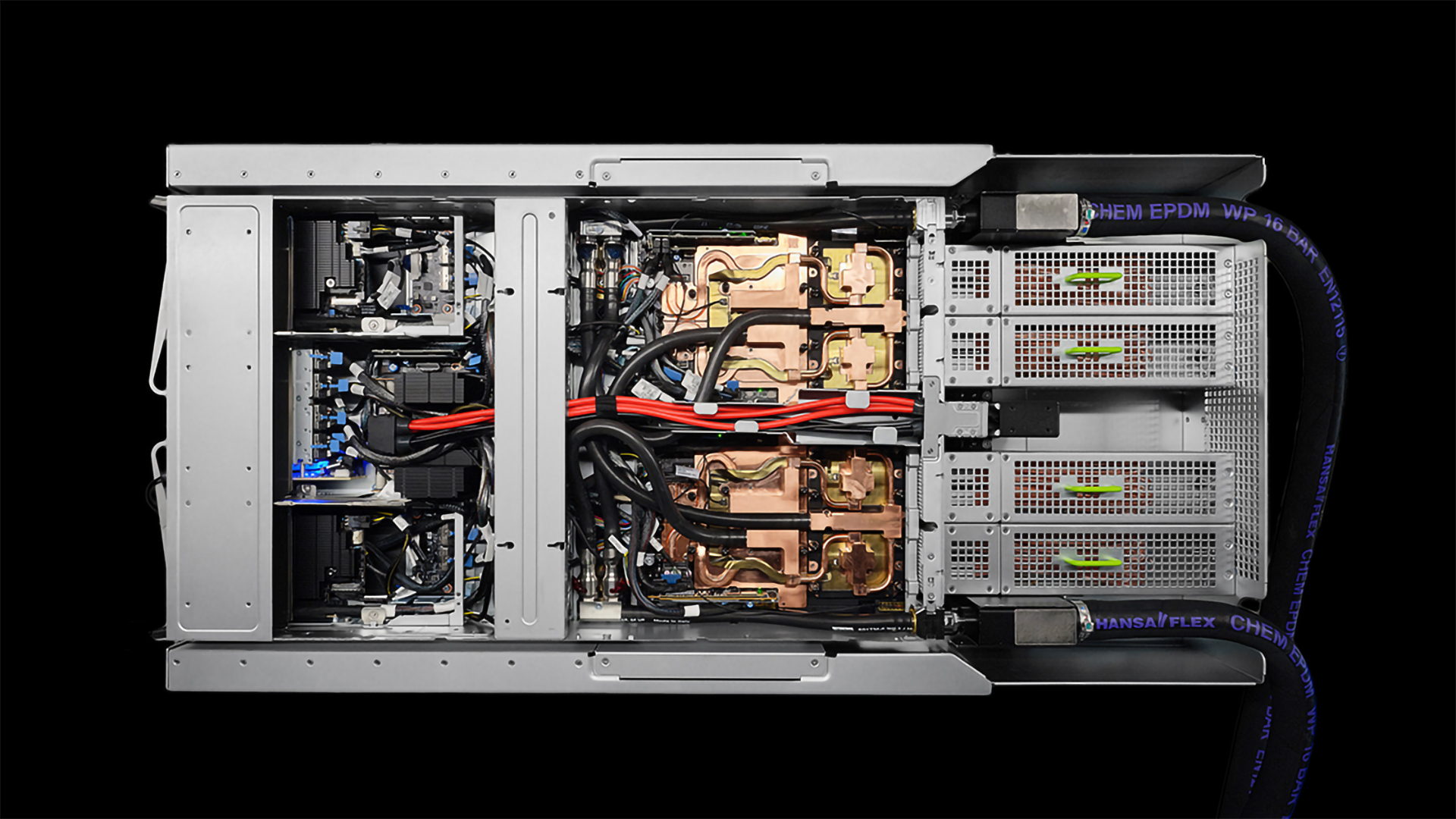

하드웨어의 핵심인 GPU 라인업 역시 화려합니다. 메타는 현재 주력인 블랙웰(Blackwell) 아키텍처는 물론, 곧 출시될 루빈(Rubin) GPU까지 수백만 개 단위로 확보하게 됩니다. 루빈 GPU는 이전 세대보다 훨씬 방대한 매개변수를 가진 초거대 언어 모델(LLM)을 지원하며, 특히 실시간으로 상호작용하는 ‘AI 에이전트’의 추론 능력을 극대화하도록 설계되었습니다.

단순히 칩만 사는 것이 아닙니다. 메타는 수백만 개의 칩을 하나로 묶어 거대한 슈퍼컴퓨터처럼 작동하게 만드는 스펙트럼-X(Spectrum-X) 이더넷 스위치 기술도 함께 도입합니다. 이는 데이터 센터 내에서 수만 개의 GPU가 병목 현상 없이 데이터를 주고받을 수 있도록 하는 신경망 역할을 합니다. The Verge는 이번 딜을 두고 “엔비디아와 메타가 하드웨어와 소프트웨어를 아우르는 ‘딥 코드디자인(Deep Codesign)’을 통해 AI 프론티어의 기반을 다지는 과정”이라고 평가했습니다.

아폴로 계획을 넘어서는 투자, 그 이면의 전략적 계산

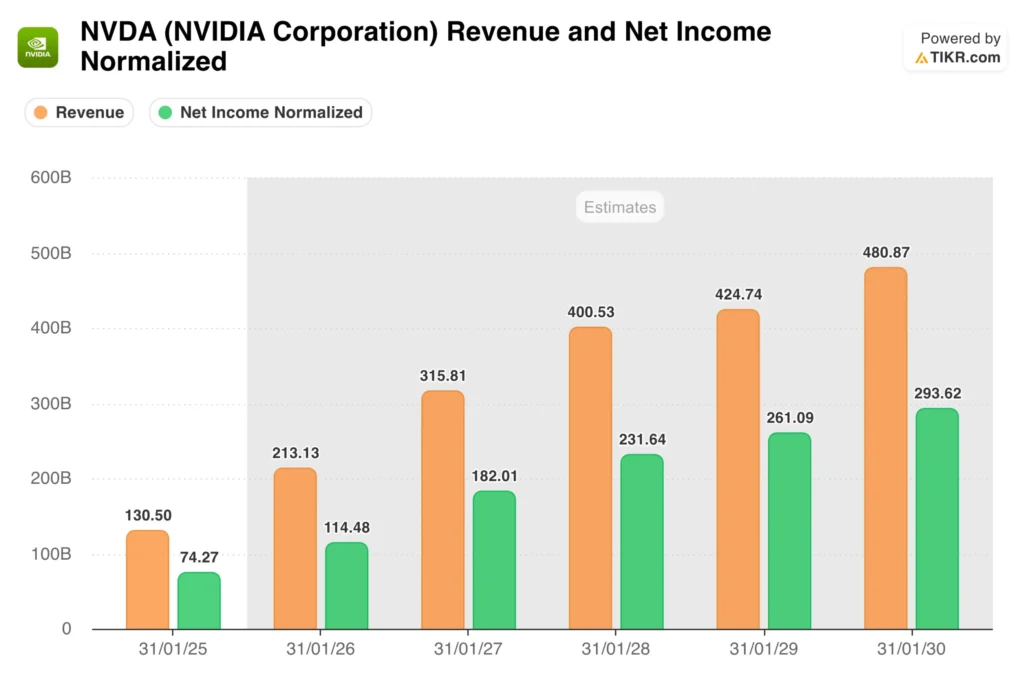

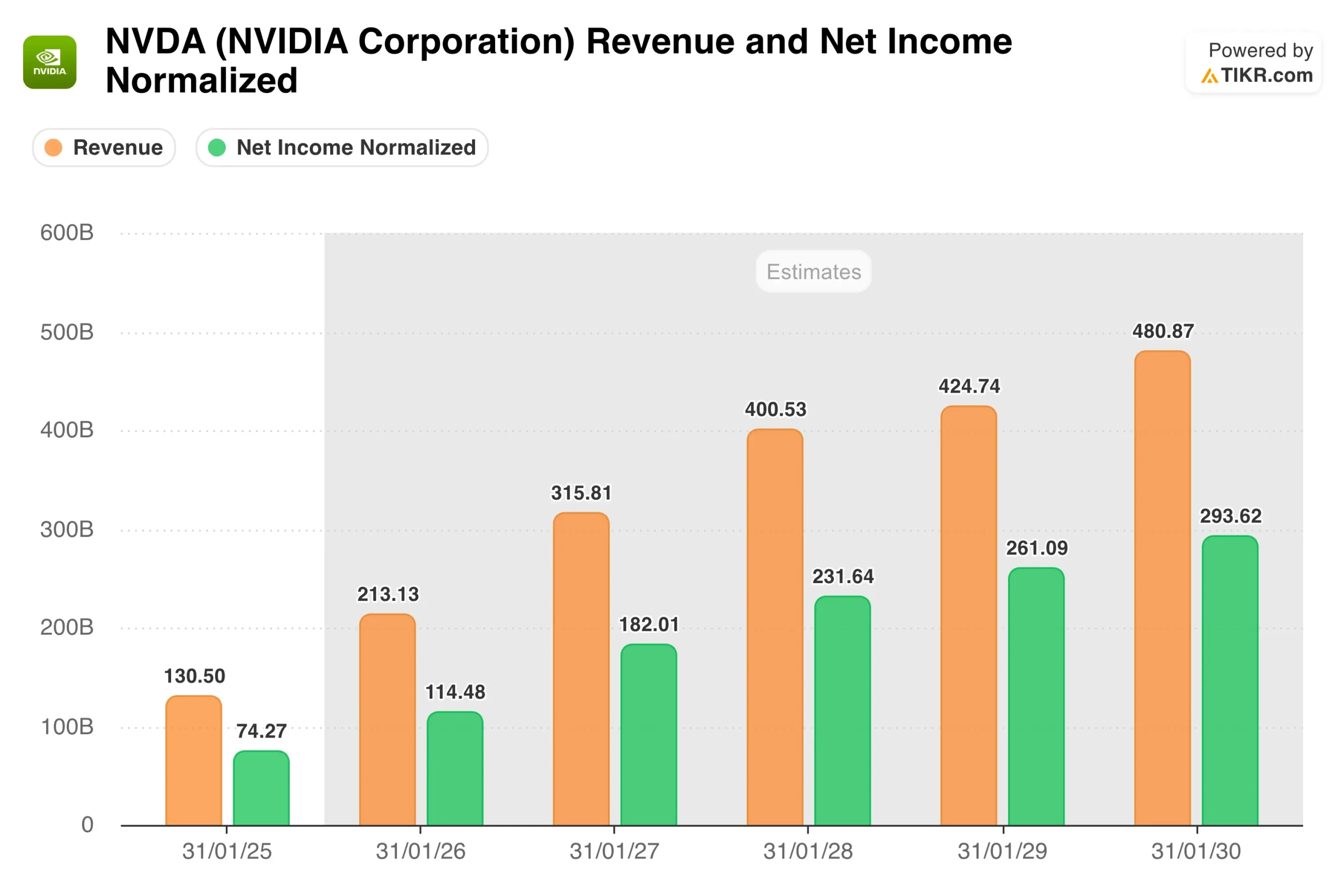

이번 계약의 구체적인 금액은 공개되지 않았지만, 전문가들은 메타를 포함한 빅테크 4사(메타, 마이크로소프트, 구글, 아마존)의 올해 AI 관련 지출이 과거 아폴로 우주 계획(Apollo space program)의 총비용을 넘어설 것으로 추정하고 있습니다. Axios에 따르면, 메타는 이번 계약에만 수백억 달러를 투입할 것으로 보이며, 이는 엔비디아를 자사 컴퓨팅 전략의 확고한 중추로 삼겠다는 선언과도 같습니다.

“이번 합의는 차세대 AI 경쟁에서 엔비디아가 메타 컴퓨팅 전략의 백본(Backbone)임을 명확히 보여준다.” – Axios 분석

흥미로운 점은 이러한 밀월 관계 이면에 숨겨진 견제와 균형입니다. 메타는 자체 칩인 MTIA(Meta Training and Inference Accelerator)를 개발 중이며, AMD 및 구글의 텐서(Tensor) 칩 도입도 검토해 왔습니다. 실제로 지난 11월 메타가 구글 칩 사용을 고려한다는 보고서가 나왔을 때 엔비디아의 주가가 4% 하락하기도 했습니다. 하지만 결국 메타가 다시 엔비디아와 손을 잡은 것은, 폭발적으로 증가하는 AI 수요를 감당할 수 있는 안정적인 공급망과 압도적인 소프트웨어 생태계(CUDA 등)를 갖춘 대안이 현재로서는 엔비디아뿐이라는 현실을 반영합니다.

결론: 메타와 엔비디아가 열어갈 2027년의 AI 풍경

메타와 엔비디아의 이번 다년 계약은 2026년을 기점으로 AI 산업이 ‘실험의 단계’를 지나 ‘인프라의 완성 단계’로 진입했음을 시사합니다. 메타는 확보한 수백만 개의 칩을 통해 라마(Llama) 시리즈의 차기 버전을 완성하고, 모든 메타 플랫폼(Instagram, Threads, WhatsApp 등)에 초개인화된 AI 에이전트를 심을 것입니다.

2027년 베라(Vera) CPU와 루빈(Rubin) GPU가 본격적으로 메타의 데이터 센터에 안착하게 되면, 우리는 지금껏 경험하지 못한 수준의 AI 상호작용을 목격하게 될 것입니다. 텍스트와 이미지를 넘어, 실시간 영상 이해와 복잡한 추론을 수행하는 AI가 우리 일상에 깊숙이 자리 잡는 시대. 그 밑바탕에는 오늘 발표된 수백만 개의 실리콘 칩이 자리하고 있습니다. 엔비디아는 다시 한번 인공지능 시대의 ‘무기 상인’으로서 독보적인 지위를 확인했고, 메타는 그 무기를 가장 강력하게 휘두르는 ‘정복자’의 위치를 공고히 했습니다.

참고 자료

- Meta’s new deal with Nvidia buys up millions of AI chips – The Verge

- Meta expands Nvidia deal to use millions of AI data center chips – CNBC

- Meta makes massive deal with Nvidia – Axios

- Meta Builds AI Infrastructure With NVIDIA – NVIDIA Newsroom

- Nvidia to sell Meta millions of chips in multiyear deal – Reuters (via Yahoo Finance)